La Ley de IA de la UE se implementó en 2024 y se implementará por completo de forma gradual en los estados miembros europeos hasta 2027. Su objetivo es garantizar que los sistemas de IA se utilicen de forma segura, transparente y legal, que se protejan los derechos fundamentales y que se minimicen los riesgos para los usuarios.

En el siguiente artículo descubrirás qué significa específicamente el reglamento para las empresas de Europa y del resto del mundo.

¿Qué es la Ley de IA de la UE y qué es el Reglamento de IA?

La Ley de IA de la UE es un conjunto de normas adoptadas por los Estados miembros europeos para regular la inteligencia artificial (IA). Su objetivo es equilibrar la tensión entre la protección de los derechos fundamentales y, al mismo tiempo, crear espacio para la ciencia y la innovación en IA en la investigación y la industria. Esto busca fortalecer la confianza en los sistemas de IA.

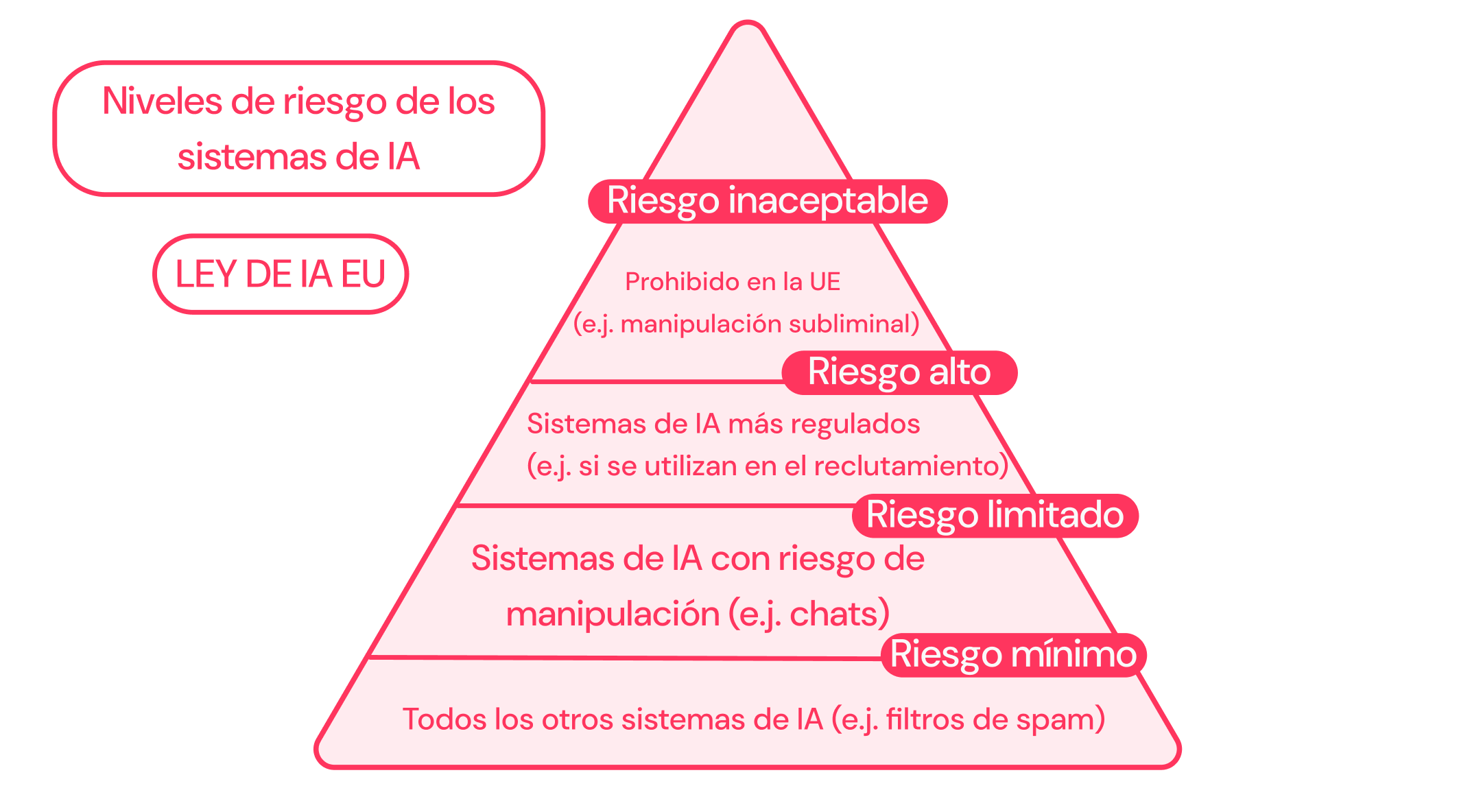

La ley sigue un enfoque basado en el riesgo , lo que significa que los sistemas de IA están regulados con distintos grados de estrictez dependiendo de su riesgo potencial para los usuarios y la sociedad .

El Reglamento sobre IA se puede encontrar aquí:

- Ley de IA de la UE (castellano)

- Ley de IA de la UE (PDF) (inglés)

También puedes ver la guía de la Ley AI para pequeñas empresas

👉 Descarga gratis es informe global sobre inteligencia artificial 2025

Base legal:

- La Ley de IA de la UE es el primer reglamento integral de la UE que regula la IA.

- Según la ley, los sistemas de IA se regularán con distintos grados de rigor dependiendo del riesgo potencial para los usuarios y la sociedad.

- Todas las aplicaciones de IA deben ser rastreables, transparentes y diseñadas para evitar la creación de contenido ilegal.

¿Quién está obligado por el Reglamento de IA y cuál es el requisito central del Reglamento de IA?

La Ley de IA de la UE impone obligaciones a las empresas que ofrecen aplicaciones de IA. El artículo 3 del Reglamento de IA define claramente a quién se dirige la ley:

- Proveedor : Personas físicas o jurídicas, autoridades públicas u otros organismos que desarrollan o encargan el desarrollo de un sistema o modelo de IA de propósito general y lo comercializan o lo ponen en servicio bajo su propio nombre o marca registrada. Esto se aplica independientemente de si se realiza de forma gratuita o a cambio de una tarifa.

- Operadores : Aquellos actores que utilizan un sistema de IA bajo su propia responsabilidad en un contexto profesional o empresarial.

- Representantes autorizados : Actores que han sido autorizados por escrito por el proveedor para cumplir determinadas obligaciones bajo el Reglamento de IA en su nombre.

- Importador : persona física o jurídica establecida en la UE que introduce en el mercado de la Unión un sistema de IA que lleva el nombre o la marca registrada de una persona establecida fuera de la UE.

- Distribuidor : Personas físicas o jurídicas de la cadena de suministro que introducen un sistema de IA en el mercado de la UE, distintos de los proveedores o importadores.

La idea principal del reglamento, que debe ser seguido e implementado por los actores mencionados, es que los sistemas de IA pueden representar riesgos para los derechos fundamentales. Por lo tanto, los modelos de IA se clasifican según el riesgo que representan para los derechos fundamentales. Cuanto mayor sea el riesgo, más estrictos serán los requisitos que los actores deben cumplir, por ejemplo, en materia de transparencia, documentación o supervisión.

👉 Lee también: Factorial presenta One, el agente de IA que transforma la gestión empresarial en Europa

¿Cuáles son los puntos clave de la Ley de IA de la UE y qué significa un enfoque basado en el riesgo?

Los puntos clave de la Ley de IA de la UE incluyen:

Clasificación de sistemas de IA basada en riesgos

La UE clasifica los sistemas de IA según el riesgo que representan para las personas y la sociedad. Esto significa que, a mayor riesgo, más estrictos son los requisitos de transparencia, seguridad y supervisión .

- Prohibición de aplicaciones con riesgo inaceptable:

Se prohíben ciertas aplicaciones que manipulan o discriminan a las personas. Estas incluyen, por ejemplo:- Juguetes controlados por voz que fomentan comportamientos peligrosos en los niños

- Sistemas de puntuación social que clasifican a las personas en función de determinadas características (por ejemplo, comportamiento social o estatus socioeconómico)

- Identificación remota biométrica en tiempo real en espacios públicos, como el reconocimiento facial

Según la Ley de IA de la UE, estas aplicaciones se consideran un riesgo inaceptable para las personas y la sociedad.

- Sistemas de IA de alto riesgo:

Los sistemas de IA que representan un riesgo muy alto se permiten bajo ciertas condiciones, como pruebas, monitoreo y certificación . Se dividen en dos categorías principales:- Sistemas de IA en productos (por ejemplo, dispositivos médicos, vehículos, juguetes)

- Sistemas de IA en ciertas áreas de la sociedad (por ejemplo, infraestructura crítica, educación, aplicación de la ley)

Todos los sistemas de IA de alto riesgo se evaluarán a lo largo de su ciclo de vida. Además, los ciudadanos de la UE tendrán la oportunidad de presentar quejas sobre los sistemas de IA .

- Otras clases de riesgo son:

-

Riesgo limitado: Un chatbot que proporciona a los clientes información general del producto. No proporciona información crítica para la seguridad, pero los usuarios deben saber que las respuestas son generadas por IA.

-

Riesgo mínimo: Una aplicación de IA para la corrección ortográfica y gramatical de documentos de texto. Apoya a los usuarios, pero prácticamente no supone ningún riesgo para la salud, la seguridad ni los derechos fundamentales.

-

Requisitos de transparencia

Los requisitos de transparencia se aplican a todos los sistemas y aplicaciones de IA. Por ejemplo, los modelos de base generativa como ChatGPT no se clasifican como de alto riesgo, pero aun así deben cumplir con las obligaciones de transparencia y la legislación de derechos de autor de la UE .

Esto significa:

- Divulgación: debe indicarse claramente que el contenido se creó utilizando IA.

- Evitar contenidos ilegales: los modelos de IA deben diseñarse de tal manera que no se pueda generar ningún contenido ilegal.

- Resumen de derechos de autor: al utilizar datos de entrenamiento, se deben crear y divulgar resúmenes del contenido protegido por derechos de autor.

Las autoridades nacionales también deberían proporcionar entornos de prueba en los que los modelos de IA puedan probarse de manera controlada antes de su implementación generalizada.

👉 Te puede interesar: 50 usos de la Inteligencia Artificial para optimizar tu día a día en el trabajo

¿Cuándo entra en vigor la Ley de IA de la UE? – Cronología de la Ley de IA de la UE

No todas las disposiciones del Reglamento de IA deben implementarse de inmediato. Su implementación es escalonada y difiere entre las empresas que implementan nueva IA y las que ya cuentan con soluciones existentes.

Por lo tanto, a la pregunta «¿Cuándo entrará en vigor el Reglamento sobre IA?» hay que responder con fechas diferentes.

Regulación de la IA: estado actual:

- 12 de julio de 2024: Publicación del Reglamento de IA (Ley de IA de la UE) en el Diario Oficial de la UE. La ley ya es oficial y está en vigor.

- 2 de agosto de 2024: El reglamento entra en vigor y comienza un período de transición de 24 meses .

- 2 de febrero de 2025:

- Prohibición de sistemas de IA con riesgos inaceptables (por ejemplo, puntuación social).

- Inicio de la alfabetización obligatoria en IA (formación para empleados).

- 2 de agosto de 2025:

- Entrada en vigor de normas de gobernanza central y obligaciones para los proveedores de modelos GPAI (IA de propósito general como ChatGPT).

- 2 de agosto de 2026:

- La mayoría de las obligaciones para los sistemas de IA de alto riesgo entran en vigor. Estos sistemas se enumeran en el Anexo III del reglamento, por ejemplo, la IA en recursos humanos o en la gestión de infraestructuras críticas.

- Derechos adquiridos: Los sistemas de IA de alto riesgo que se pongan en funcionamiento antes de esta fecha no tienen que implementar las nuevas normas de inmediato, siempre que no se produzcan cambios significativos . En cuanto se produzca un cambio significativo, los derechos adquiridos expirarán.

- 2 de agosto de 2027:

- Aplicación plena de la ley a determinados sistemas de IA de alto riesgo enumerados en el Anexo I que se utilizan como componentes de seguridad en productos (por ejemplo, dispositivos médicos).

- La protección también finalizará para los modelos GPAI que salieron al mercado antes del 2 de agosto de 2025.

- 31 de diciembre de 2030:

- Período de transición más largo para determinados sistemas informáticos de grandes autoridades públicas .

Todavía es necesario incorporar al derecho nacional las autoridades competentes y las normas sobre sanciones y multas.

¿Qué significa la Ley de IA de la UE para las empresas y cómo se lleva a cabo la evaluación de riesgos de los sistemas de IA según la Ley de IA de la UE?

Importancia para las empresas

La Ley de IA de la UE afecta a las empresas que desarrollan, operan o distribuyen aplicaciones de IA . Para las empresas, esto significa:

- Evaluación de riesgos: Debe evaluar la categoría de riesgo en la que se encuentran sus sistemas de IA (riesgo inaceptable, riesgo alto, riesgo limitado, riesgo mínimo). Esto aplica a todos los operadores de modelos de IA.

- Obligaciones de cumplimiento: Dependiendo de la categoría de riesgo, se deben cumplir requisitos como transparencia, documentación técnica, certificación y notificación de incidentes graves. Los operadores de sistemas de IA de riesgo limitado, por ejemplo, solo necesitan indicar que son sistemas de IA .

- Capacitación: Los empleados deben recibir capacitación sobre el uso seguro y legal de la IA, de acuerdo con la Alfabetización en IA . Sin embargo, esto solo aplica a los operadores de sistemas de alto riesgo.

- Monitoreo y documentación: Los sistemas de IA de alto riesgo deben monitorearse, documentarse y evaluarse durante todo su ciclo de vida.

¿Cómo afecta el Reglamento sobre IA de la UE a las empresas de fuera de la UE?

El Reglamento de IA (AI VO) se aplica independientemente de si las empresas tienen su sede en la UE o no. Esto significa que las empresas de fuera de la UE también deben cumplir los requisitos de la Ley de IA de la UE si ofrecen, distribuyen u operan sistemas de IA en la UE .

Factorial One: Trabajo con apoyo de IA eficiente y conforme a la legislación

Muchas empresas utilizan actualmente diversas aplicaciones de IA en su trabajo diario. La responsabilidad del cumplimiento de los requisitos legales no recae en las propias empresas, sino en los desarrolladores de los sistemas.

Con Factorial IA, las empresas obtienen una solución que comprende a la perfección sus estructuras, equipos y objetivos. En lugar de perder tiempo valioso en procesos manuales, las tareas pueden completarse hasta tres veces más rápido. El resultado: información clara y basada en datos que impulsa el crecimiento. Esto les permite aumentar su impacto y reducir costes: un verdadero apoyo en su trabajo diario.

- Seguimiento de desempeño: Transcripción en vivo de reuniones individuales, resúmenes estructurados con contexto (señales de pulso, notas anteriores, cambios de KPIs) y creación automática de un plan de acción editable.

- Reclutamiento/talento: Descripciones de trabajo automatizadas, coincidencias inteligentes de candidatos, resúmenes de CV y proceso de reclutamiento acelerado mediante IA.

- Gestión del tiempo: Planificación de turnos automatizada, definición sencilla de reglas, sugerencias respaldadas por IA y publicación rápida.

- Gestión financiera: Escaneo móvil de recibos, captura de datos OCR con IA, asignación automática de políticas y centros de costos, recordatorios para la presentación oportuna.

- Análisis/Informes: Respuestas instantáneas a partir de datos en tiempo real, informes automáticos, análisis precisos sin Excel ni analistas.

Con el software empresarial de IA de Factorial, los equipos se benefician de las ventajas de la IA sin correr riesgos legales y pueden estar seguros de que todas las funciones se implementan de conformidad con las regulaciones de la UE.